这个课题在我本科阶段就一直很想做,所以在毕业设计的时候也以此为毕业课题,从设计合作目标,到最后实现整个系统也花了我蛮久的时间。虽然在毕设中拿到了优秀,但是实际做的还是比较粗糙的,自己也不能满意,但为了有了结果,只好大概实现了实时的位姿估计,怎么插入视频我还没学会,那就先放点图片吧。

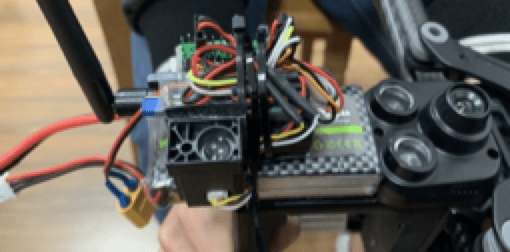

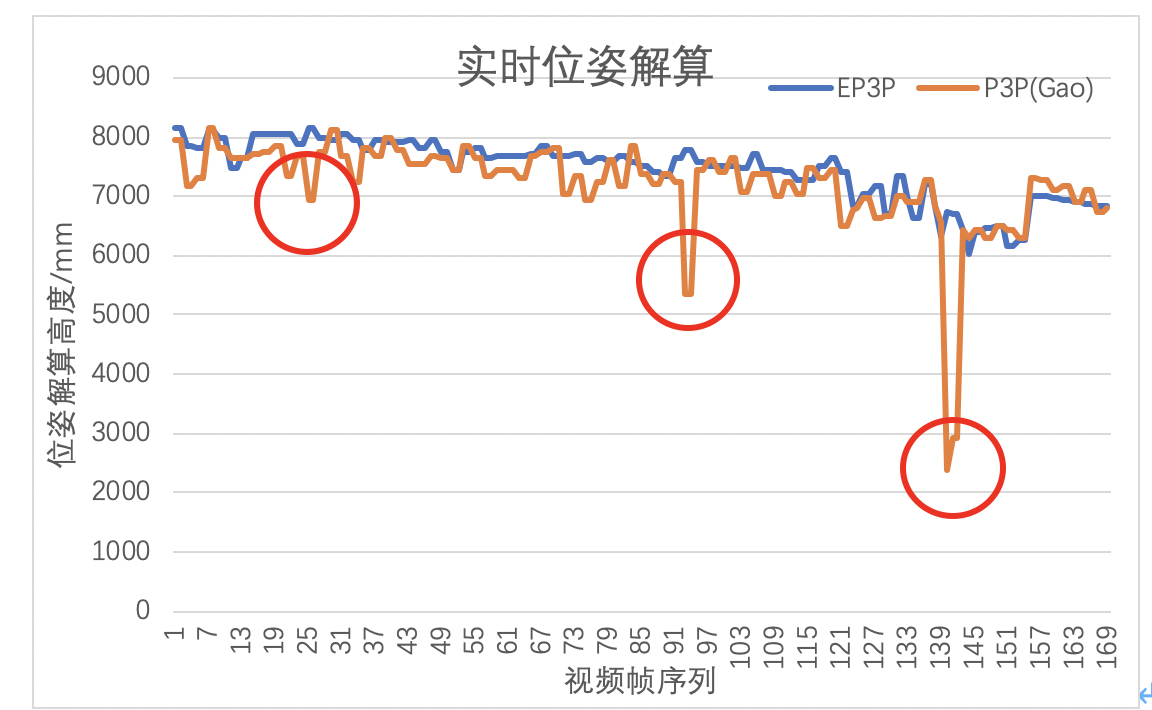

实验结果有了,但是实验的真值其实是很难获取的,理想的是你能够获得着陆点和飞机实时的空间GPS坐标,按照目前的技术,可以采用大疆D-RTK等设备,大概的定位精度是10cm,把飞行过程中的视频帧与GPS坐标对应起来,然后再用位姿估计的去进行误差分析。当时由于设备和时间限制,我就只针对高度的真值进行误差分析,具体的高度真值是通过在飞机上挂载精度为2cm的激光雷达,然后通过串口将实时的高度数据发送出来,电脑通过Labview和串口把飞行过程中飞机的高度曲线记录下来作为高度真值,具体实验图片如下图所示:

选用激光雷达是因为其相比于超声波测量范围大,精度2cm也足够了,还有一个原因是因为悟自身也用超声波来辅助定高,如果我下面再加超声波,会造成飞机定高存在问题,导致翻车。最后实验结果在算法稳定度和精度均符合当时的设计要求,10米内的误差大概在10cm左右,算法稳定度也远好于现有的P3P算法。

好了,现在回归正题,我们从整个课题的最开始进行研究分析,此课题设计到两大内容:一是对移动平台的视觉相对位姿估计系统,二是主动测量平台的控制策略与任务调度。我们首先说视觉相对位姿估计系统,如果我是产品经理的话,那么我想提如下的需求。

视觉相对位姿估计系统

² 可实现1m~300m范围内的合作目标识别

² 可实现1m~10m范围内对着陆平台运动状态和姿态变化的轨迹预测

² 可实现对合作目标所含特征信息的亚像素提取

² 可实现在目标存在部分遮挡或环境存在烟雾、强光等条件下的位姿估计

² 可利用GPU加速或机器学习的方法构建高效率、低延时的视觉优化方案

² 可实现相对位姿估计系统的结果与多个测量系统之间的交互

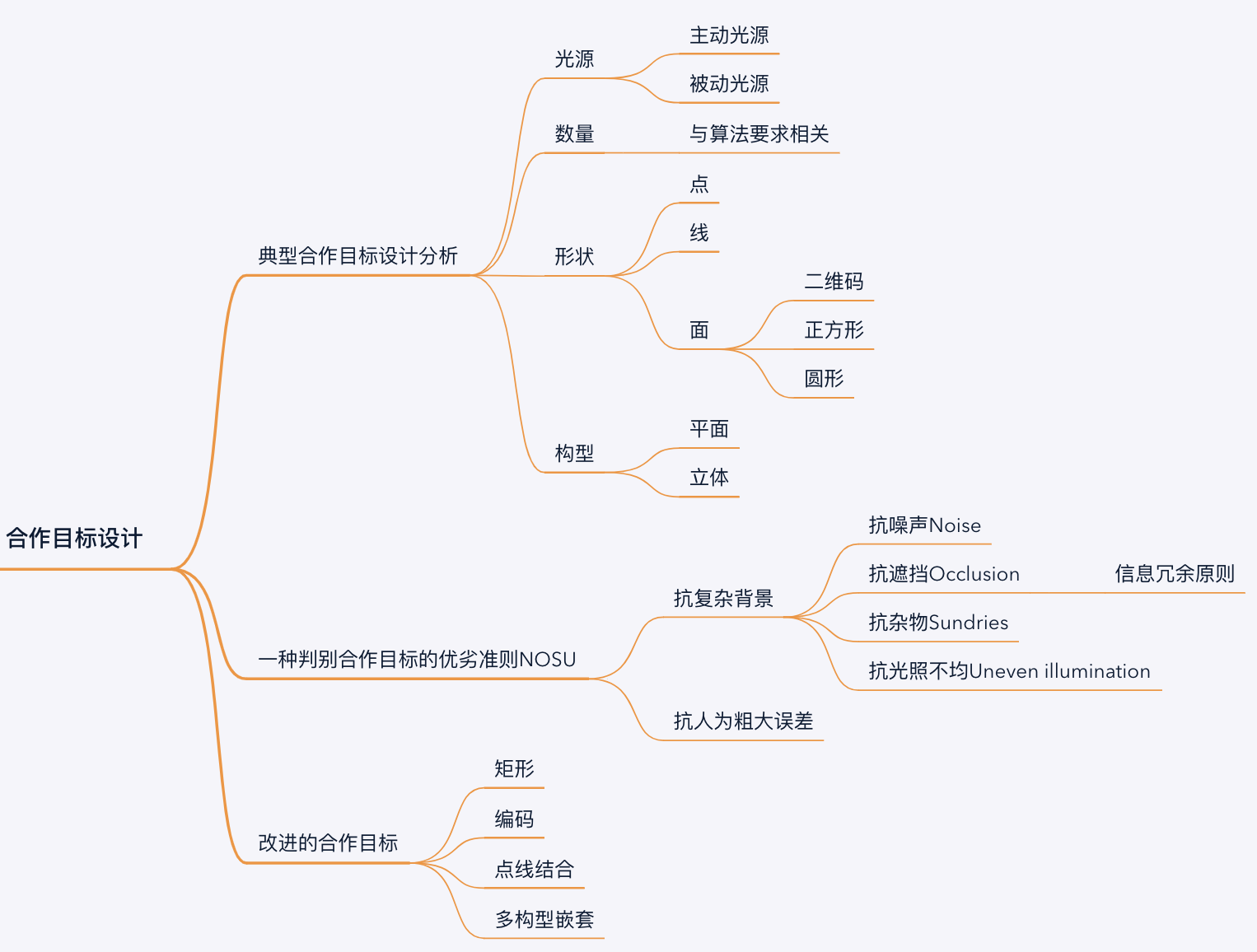

在实现这个系统之前,我们首先需要考虑的是,如何能够设计出一款既简单抗干扰性又好,最好还能自带编码,那么我们就只需要考虑视觉提取匹配以及位姿估计的算法就行了。但实际是合作目标的设计上很难同时兼顾多个方面,其中各个特征之间对位姿估计的影响的模型目前也不清楚,所以如果想把合作目标的设计作为一个优化问题去考虑的话是很难量化的,如果能够构建点、线特征和其数量对位姿估计的数学模型,那么合作目标的设计就有据可依,不再是大家靠经验去简单布置。

在本科毕设做这个课题的时候,我几乎研究了大部分国外在位姿估计中用到的合作目标,大部分都是利用Apriltag,包括现在走在Robotics最前沿的 Boston Dynamics,因为其每个tag都是一个ID也就解决了编码匹配问题,其使用图像的梯度来获取tag,这样让他在光照的改变上更加的实用,ARTag 也提供第一个向前纠错的解码系统,这个让tag容易产生,快速纠错,也提供更好的识别算法,所以其在机器人领域广泛应用。

但目前应用在空间交会对接、固定翼无人机着舰、无人船舶自主回收等特殊领域的位姿估计算法很难采用这种机器人视觉系统,大多都是由点、线构成,通过单目或多目的方式进行相对位姿估计,所以建立一套能够在此领域发挥作用的视觉基准库对航空、航天、航海还是很有意义的。

所谓的合作目标设计,也就在考虑如下因素的基础上,加上相机的成像模型与应用距离的范围,对合作目标的存在的多种组合按照一定的约束进行筛选,找出最恰当的点、线分布状态。